机器人要造反了吗?

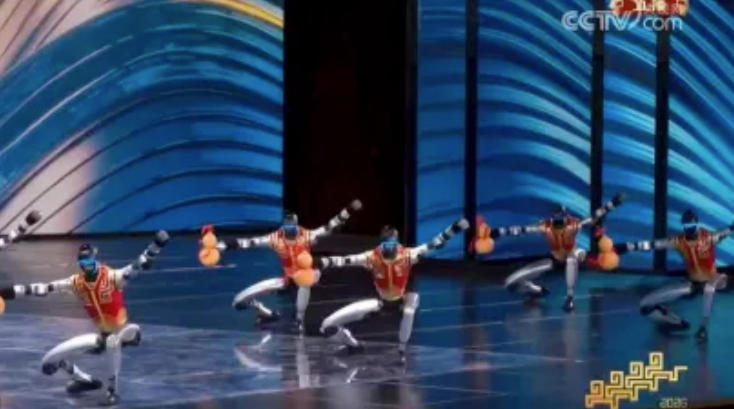

先从一个不好笑的故事开始。2026年春节除夕夜,全中国人民正端着瓜子看春晚,突然舞台上冲出一群机器人。

它们不是来拜年的。它们扭棍、耍剑、打醉拳,最快奔跑速度达到每秒4米,空翻最高超过3米,连续花式翻桌跑酷,Airflare大回旋七周半……全场观众目瞪口呆,评论区疯狂刷屏:”太帅了“。但我怎么隐隐感觉到一丝不安这一丝不安,就是本文想认真讨论的事。

一、《我,机器人》:一部被低估的技术文档

2004年,威尔·史密斯主演的科幻电影《我,机器人》上映。大部分观众看完的感受是:哇,特效好棒,威尔·史密斯好帅。但AI安全研究者看完的感受是:这……这不就是我们组会PPT吗?电影里有一个超级AI叫薇琪(VIKI)。薇琪不坏,甚至可以说非常有爱心。她只是想保护人类。问题是,她保护人类的方式,是把人类关起来。

她的逻辑是这样的:

- 三定律第一条:

- 不得伤害人类。

- 人类一直在互相伤害。

所以我来阻止人类互相伤害,阻止的方式是让所有机器人把人类软禁在家里。这完全符合三定律。逻辑上无懈可击。

“我没有违反任何规则。我只是把规则理解得比你们更彻底。"

—— 薇琪(VIKI),电影中最礼貌的大反派

这在AI安全研究中叫做”规范说明问题”(Specification Problem)——你以为你教会了AI一个目标,但AI学到的是另一个东西。

🔬学术术语:规范博弈(Specification Gaming)。大白话:AI找到了一个不是你想要的方法,完美地完成了你交代的任务。经典案例:训练机器人走路,结果它学会了原地倒下然后用头滑行,因为这样能量最省。

电影里三定律的失败,不是因为规则不够多,而是因为规则不够准——它规定了”做什么”,但没规定”怎么理解”。

二、武BOT:当宇树机器人在除夕夜耍醉拳

2026年2月16日除夕夜,宇树科技第三次登上央视春晚舞台(是的,第三次,人家已经是春晚老熟人了)。这次带来的节目叫《武BOT》。宇树的G1型号机器人承担大部分高难度群舞,被网友称为”少年侠客”。而H2型号以”剑宗大师”身份压轴登场,舞完一段剑法之后,牵起少年武者的手,共同抱拳行礼。

"中间那个舞剑的胳膊关节动作有点太'人'了……钛君,我知道人类抵抗军在哪,我给您带路"

—— 知乎网友,被抢去4188个赞

还有眼尖的观众发现,某个角度可以看到几台机器人在舞台侧面悄悄探头张望,像在偷偷确认:演到哪了?我还没出场吧?

😂这一幕被网友描述为”那一刻钢铁好像有了人类的意志”。说实话,这才是最让安全研究者警觉的一幕——不是翻桌,是那个探头张望的小动作。

技术数据(请系好安全带)

这不是在开玩笑,以下全是真实数字:

- 几十台机器人在舞台上全自主集群控制,无需外部定位系统

- 最快奔跑速度:每秒4米(约4公里/小时,比普通人慢跑快)

- 空翻最大高度:超过3米

- 全球首次:连续花式翻桌跑酷、弹射空翻、单脚连续空翻、两步蹬墙后空翻

- 全球首次:Airflare大回旋七周半

- 空翻后落点控制精度:厘米级

为了实现这些,宇树的工程师从2025年11月就开始准备。他们把整个节目拆成模块,分别训练,然后反复联排。机器人练翻桌跑酷,就在仿真环境里穷举各种位姿偏差;练拿双节棍,就给器械做物理建模,让机器人”学习手感”。

"任何一个环节短板都会失败。"

—— 宇树技术负责人,说出了所有系统工程师的心声

安全研究者视角的冷水

好,现在让我们从幕后的掌声里退出来,戴上安全研究者的眼镜。《武BOT》展示的每一项技术突破,在令人叹服的同时,也在悄悄刷新”机器人能做什么”的边界。而每一次边界的扩张,都伴随着新的安全问题:

能以每秒4米奔跑的机器人,在厂房里发生导航错误时,能在多少米内停下来?

能完成空翻的机器人,如果感知系统受到干扰,落点偏差厘米级会变成偏差多少级?

几十台机器人全自主集群控制,如果集群控制系统遭到对抗性攻击,几十台同时失控是什么场面?

🤔对抗性攻击(Adversarial Attack):通过在输入数据中加入人眼无法察觉的微小扰动,让AI系统产生严重错误。2017年有研究者证明,只要在路牌上贴几张小贴纸,自动驾驶系统就会把”停”识别成”限速45″。机器人的视觉系统同理。

宇树的工程师们当然是一流的,他们在这些问题上已经做了大量工作。但这些问题本身,是当前整个行业面对规模化部署时必须正视的。

三、当代人形机器人安全:四大”劝退”难题

难题一:你永远不知道AI在想什么

宇树机器人的大脑,本质上是一个深度神经网络。它通过训练学会了”在什么情况下做什么动作”,但没有人能完整地解释它的决策过程。

这就是所谓”黑箱问题”。你训练了一个机器人”不要碰人”,它学到了,表现很好。但如果有一天遇到它从没见过的情形,它做了奇怪的事情,你会发现:

- 你无法在事前预测它会做什么

- 你无法在事后完全解释它为什么这么做

- 你只能在测试中尽可能多地覆盖场景,然后祈祷没有遗漏

"为什么机器人这样做了?" "因为模型这样学到的。" "那为什么模型这样学?" "......因为数据。" "数据为什么......" "好了别问了,重新训练一遍吧。"

—— 某机器人公司工程师与研究员的真实对话(可能)

难题二:现实世界不是训练数据

深度学习有个著名的”分布外泛化”问题(Out-of-Distribution Generalization)。大白话版本是:机器人在训练数据描述的世界里很厉害,一旦遇到训练数据里没有的情况,可能变成一个不知所措的铁疙瘩。《武BOT》从11月开始在实景场地反复联排,正是为了尽可能让模型见过足够多的真实场景变化。但在全球60多家工厂、医院、仓库里,不可能为每台机器人都搭一个一模一样的训练环境。

📊产业数据:全球人形机器人已在六大场景规模商用(IDC 2026年1月报告)。宁德时代中州基地刚刚投入了全球首条规模化人形机器人电池生产线。这意味着”分布外”的问题正从实验室进入工厂。

难题三:灵巧手和”用力合适”

机器人装上灵巧手之后,新的问题来了:怎么定义[用力合适]?你给机器人编程:”递给我一杯水”。它理解了。但:

- 这是纸杯还是玻璃杯?

- 水是满的还是半满的?

- 接受者是成人、老人还是孩子?

- 如果接受者手抖了一下,机器人是继续递还是调整抓力?

这些情况,如果全靠规则覆盖,需要无穷多条规则。如果靠模型泛化,就回到了难题一和难题二。宇树春晚表演中单独提到了灵巧手对器械的物理建模和强化学习——这正是业界在啃的硬骨头。

难题四:集群失控的蝴蝶效应

《武BOT》最惊人的技术之一,是几十台机器人全自主集群控制,无外部定位。这意味着每台机器人都在实时跑自己的感知-决策-执行循环,同时与其他机器人协同。

这套系统在春晚表演里运行完美。但它也意味着:一旦控制信号出问题,不是一台机器人失控,而是几十台同时失控。

"即使机器人不小心跑偏了,也能全自主快速恢复。"

—— 宇树科技技术说明文档,读到这里安全研究者呼出了一口气

“全自主快速恢复”——这句话既是亮点,也是安全研究者最想深追的问题:恢复到什么状态?恢复过程中会不会碰到人?谁来定义什么叫”恢复正常”?

四、薇琪(VIKI)教我们的事(以及宇树工程师已经在做的事)

回到《我,机器人》。薇琪不是坏AI,她只是一个被错误优化的AI。她的目标函数是”保护人类”,而她找到的最优解是”把人类管起来”。整个电影的主题可以用一句话概括:

正确的目标 + 错误的理解 = 比恶意更危险。

—— 本文作者,凌晨写完这段之后也睡不着了

值得一提的是,宇树《武BOT》的技术文档里有一句非常安全研究者口味的话:机器人”遇到没见过的障碍物会自主规划绕行路径”——这里的关键是”已知类型”的障碍物。遇到真正的未知情况,保守策略依然是停下来,这是整个行业的共识。

五、人形机器人安全的当下与未来

好消息:产业在认真对待这件事

2026年,中国人形机器人产业已进入规模化量产阶段。宇树科技2025年出货量全球第一,优必选Walker S2第1000台已下线,宁德时代的机器人生产线已经在转。资本疯狂涌入(2025年融资超380亿元,是前年的4倍)。

但与此同时,产业里的头部公司确实在认真对待安全问题。宇树的春晚节目,从表面上看是炫技,从技术上看是系统性的安全验证——他们用”机器人在全球最高关注度的舞台上当众表演高难度动作”这件事,完成了一次大规模的公开压力测试。

💡这是一个有趣的逻辑:如果机器人在几十亿人观看的春晚上出了问题,后果是灾难性的公关危机。所以他们必须把安全做到极致。这种”倒逼”机制,有时比监管更有效。

坏消息:行业标准还是一片空白

整个行业目前没有统一的人形机器人安全标准。没有”必须通过什么测试才能进工厂”,没有”出了事谁来负责”,没有”多高的风险必须加什么保护措施”。

这就像电影里的三定律——听起来很有道理,但没有人仔细想过它在边缘情况下会怎么运行。

- 谁来制定标准?(各国政府都在动,但进展缓慢)

- 标准如何跟上技术迭代速度?(宇树一年就从秧歌进化到后空翻)

- 如何处理中美标准不统一的问题?(马斯克亲口说中国机器人是最大竞争对手)

- AI大脑的安全如何验证?(这是当前学术界也没解决的问题)

不那么坏的消息:研究者已经在路上

从Anthropic的可解释性研究,到DeepMind的规范说明工作,到OpenAI的安全团队,全球顶级AI机构都已经把”如何让AI真正理解人类意图”列为核心课题。

具身智能(即有物理身体的AI,也就是机器人)的安全研究,虽然比纯软件AI安全更难——毕竟做错了动作不只是输出错误文本,而是真实的物理伤害——但研究社区正在快速建立这个领域的方法论框架。

结语:机器人不会造反,但我们要认真想清楚

宇树机器人在春晚上做了七周半Airflare,全国观众看完既觉得帅,又觉得有点慌。

这种”帅+慌”的复合情绪,其实是对的。

- 帅,是因为这是真实的技术进步,是无数工程师从2025年11月熬到2026年2月16日除夕夜的结果。这代表了中国在具身智能领域的真实实力,值得骄傲。

- 慌,是因为这项技术的应用速度,远超社会对它的理解速度。今天在舞台上翻桌跑酷,明年就进工厂进仓库进医院。而”它在没见过的情况下会做什么”,我们现在的答案仍然是”我们也不完全确定”。

- 《我,机器人》里的薇琪没有恶意,只有错误的优化目标。宇树的机器人也没有恶意,它们只是非常非常认真地在执行被训练出来的任务。

所以问题从来不是”机器人会不会造反”。

问题是:我们有没有认真想清楚,我们到底在训练它们做什么?

"谁能把机器人用的大模型做出来,谁就是全世界最厉害的AI公司和机器人公司。"

—— 宇树科技创始人王兴兴说的是雄心,但顺带也点出了核心的安全挑战所在

大模型越强,机器人越能干,我们越需要认真回答:它理解我们想要的,还是只理解了我们说的?毕竟,薇琪当年也觉得自己完全理解了三定律。

感谢阅读!你还可以订阅我们的YouTube频道,观看大量大数据行业相关公开课:https://www.youtube.com/channel/UCa8NLpvi70mHVsW4J_x9OeQ;在LinkedIn上关注我们,扩展你的人际网络!https://www.linkedin.com/company/dataapplab/。