人工智能背后的数据科学

摘要

此文献给所有对人工智能(AI)感兴趣但是仍然未对其有深入了解的传统的数据科学家们。这篇文章对与今天大众媒体口中的人工智能相结合的数据科学技术进行了概述。

我们曾经写过一些关于组成人工智能(AI)的多种数据科学技术。我依然听到很多人把AI当做单一的个体来请教关于它的问题。其实AI并不是一个个体,而是众多数据科学技术的集合。而在现阶段的发展中这些技术还未被很好地整合起来,更不能说被易于使用。尽管如此在每一个数据科学领域,我们已经在大众媒体的关注下获得了很大进步。

这篇文章并非是一个对数据科学的深入研究,而更像是一个对数据科学现在的情况作一个通俗的走马观花式的概述。如果你是一个的传统意义上的数据科学家,或者你已经读过一些文章但是暂时未能将数据科学的重点信息了解清楚,那么这可能是一篇能帮助你将现有知识整合起来甚至能帮助你发掘自己兴趣点的文章。

AI只是其数据科学组成部分的一个集合

组成AI的数据科学组成部分分为以下几类。其中可能会有些重叠,但是这些将会是你在媒体上看到的详细类别。

- Deep Learning深度学习

- Natural Language Processing 自然语言过程

- Image Recognition 图像识别

- Reinforcement Learning 强化学习

- Question Answering Machines 问答机

- Adversarial Training 对抗训练

- Robotics 机器人学

以上便是所有不同的类别(深度学习其实包括了一些其它分类)。它们之间的联系并不紧密,多数是被初创公司和技术界的重要公司同时应用在一些新奇的项目上。它们在被成功地应用时能够产生1+1>2的效果,例如在Watson和Echo/Alexa网站上的应用,或者是开始被用在无人驾驶汽车技术中。尽管如此,这些技术的整合仍会是一个很大的挑战。

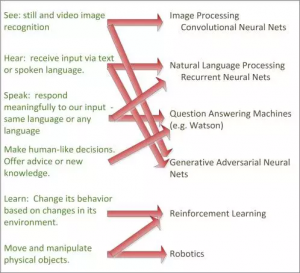

AI需要完成什么任务?

- 看:现在仍为视频图像识别

- 听:通过文字或口头语言获得输入信息

- 说:对我们的输入以相同的语言或外语作出有意义的回应

- 模仿人类做出决策:提供建议或新的知识

- 学习:基于其所处环境的改变对其自身行为做出改变

- 移动:并模仿物理对象的行为

你能够马上开始看到今天很多在商业上对AI的应用只要求其中的几种能力。但是我们期望中更复杂的应用将会需要所有这些功能。

将人类的能力转化为数据科学

在这里我们讲述的内容会开始变得凌乱和难以理解。

上面说的的每一个功能都不必要与它们对应的数据科学技术一一对应。

但是如果想要真正理解AI在今天的发展,理解数据科学技术如何与这些功能要求相匹配是很重要的。它们之间的匹配关系如下图所示。

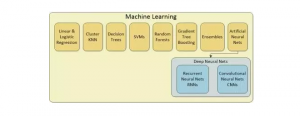

深度学习的情况

你可能注意到“深度学习”并没有在图中出现。那是因为它是上图中递归神经网络和卷积神经网络两者的集合。人工神经网络(ANNs)作为最高级的集合登记,在80年代开始被使用,并且一直是标准数据科学机器学习工具包中的一部分,被用于解决标准分类和回归问题。

最近我们更大量地运用平行处理、云处理和GPU(图形处理器)来取代传统英特尔芯片,使我们能够对不同版本的有着几甚至过百个隐藏层的ANN进行实验。这些隐藏层就是我们所说的“深度”,从而形成“深度学习”。添加隐藏层意味着增加运算复杂性,这也是我们为什么不得不等硬件发展速度赶上我们野心的膨胀速度。现在至少有27种不同类型的ANN,但最重要的是卷积神经网络(CNN)和递归神经网络(RNN),如果没有它们,图像和自然语言处理将是不可能的。

对数据科学的简单讨论

要对任何这些基础数据科学技术进行定义需要很多篇幅。 我们将在这里提供最简短的描述和一些包含更完整的信息的链接。

- 卷积神经网络(CNN):CNN是图像和视频识别、面部识别、图像标记(比如Facebook),在我们的无人驾驶汽车中辨别行人和停车标志等等这些所有类型技术的核心。它们极其复杂,难以训练,并且当你不需要指定具体的功能(猫有毛皮,尾巴,四条腿等)时,你需要给一个CNN展示数百万的猫的例子,直到其能够成功地分辨对象。 训练数据的巨大是训练CNN的一个巨大的障碍。

- 生成式对抗神经网络(GANN):CNN和RNN有着同样的问题,都需要巨大和繁重的数据量来进行训练,以识别停止标志(图像)或学习必要的指令来回答你的问题,例如如何设立帐户(语音和文本)。 GANN能够保证大幅减少训练数据以及显着提高精度,并通过互相作战实现。 这里有一个伟大的关于训练卷积神经网来识别伪造的法国印象派画作的故事。 简单地说,先将一个CNN用真正的法国印象派画作进行训练,所以它应当知道如何分辨真实的画作。 再将在此CNN之外的其他对抗性CNN(称为生成式对抗神经网络)用作创造伪造的印象派画作。

对抗性CNN通过将图像像素值转换为复数数值向量来执行图像识别的任务。 如果你将它们 逆向运行,即从任意数值向量开始运行,它们就会创建出图像,用这个方法创造伪造的画 作,试图欺骗那一个学习如何检测伪造品的CNN。 他们互相对抗,直到生成式CNN(伪 造者)伪造的图像真实到连那一个CNN都不能将它们与真实画作进行分辨。这时伪造者 CNN和分辨者CNN打成平手。

被用作分辨将伪造画作与真实画作的CNN在检测伪造品方面已经被进行了卓越的训练。在 此之后我们不必再对成千上万的法国印象派画作大师提出分辨伪造画作这种不切实际的要 求了。总的来说,这就是人工智能网络从他们的环境中学习的例子。

- 问答机(QAM):QAM是我们给IBM的Watson起的一个相当不起眼的名字。 问答机是一些巨大的知识仓库,经过培训它们可以在它们的知识库中找到独特的关联,并为它们以前没有见过的复杂问题提供答案。 当普通搜索返回可能找到能回答您问题的答案的源列表时,QAM则被设为必须给出单一最佳答案。这是NLP和复杂搜索技术的混搭,其中QAM构建关于问题的可能含义的多个假设,并且基于加权证据算法返回最佳回答。

QAM需要大量关于要研究主题的数据,这些数据由人工加载,并且随后必须用人工训练和 维护知识库。 然而,一旦建立,他们已被证明在多个领域具备专业能力,包括癌症检测 (与CNNs结合)、医学诊断、发现材料和化学品的独特组合、甚至指导的高中学生如何编 程。 简而言之,对于任何一个 巨型的需要专业编译的知识体,QAM都可以像大脑一样对其 进行编译(或至少形成AI的关联记忆)。

- 加固学习系统(RLS):RLS是一种对系统进行训练以从对其环境作出直接响应的可能性结果中识别最佳结果的方法。 这里没有单一的算法,而是一组定制应用程序。 RNN可以作为RLS中的一种类型的“代理”。 RLS是无人驾驶汽车和类似设备中的核心技术,它不需要语言界面。 本质上,这是一个机器可以学习并记住在特定情况下应采取的最佳行动的方法。 当你的无人驾驶汽车决定在黄灯前停下,而不是通过时,RLS就被用来创造其通过学习获得的行为。

- 机器人学:机器人领域对于AI非常重要,因为它是AI数据科学在现实世界中体现的主要方式。 大多数机器人是直接又复杂的工程。 机器人技术背后的AI技术主要是加强学习。

- Spiking神经网络(又称神经计算):我们之前常说我们还处在在人工智能技术的第二代,这主要是基于我们在硬件上所实现的进步。这些进步使我们能够使用算法,如神经网络,这在过去是不可行的。 但所有这一切都非常迅速,现在我们正处于进入第三代人工智能的前沿。

第三代人工智能将基于Spiking神经网络(也称为神经形态计算)进行发展,因为它试图更密切地模仿大脑实际工作的方式。 第三代变化的核心围绕着脑神经元不经常彼此通信,而是在信号的尖峰这个事实。 我们的挑战是找出一个合适的方法将消息编码进这个电脉冲串中。

目前我们还在中期研究阶段,我只知道它的两个被应用于商业应用程序的实例。 很多投资和脑力正在涌入这一发展。 它还将需要一种全新类型的芯片,这将意味着另一个硬件革命。

当Spiking神经网络到达时,我们期待:

它们可以从一个来源学习,并应用到另一个来源。 它们可以概括他们的环境。

它们可以记住已经做过的事情。 一旦学习的任务可以被调用并应用于其他数据。

它们更节能,打开了一条小型化的道路。

它们从自己的环境中学习,没有监督,只有很少的例子或观察对象。 这使它们快速学习。

跟上AI的发展

为了跟上AI的发展,我们需要跟随以上介绍的技术和两个趋势。

一是AI的商业化,因为它目前(第二代)以一种飞快的速度被运用到几乎一切东西上。AI在未来很可能与电气化在20世纪20年代的美国一样普遍。

二是Spiking神经网络的进步,它们将使这一切都更令人惊叹。