ChatGPT和LLM的10个关键术语和概念

数据科学和人工智能领域的新星是大型语言模型(LLM)。LLM的迅速流行始于ChatGPT,并很快在社交媒体、博客和科学论文中流行起来。

本文旨在帮助那些想了解LLM但由于技术术语或领域概念而难以理解LLM内容的人。如果你想了解更多关于人工智能的相关内容,可以阅读以下这些文章:

如何一眼识别人工智能生成的图像!

一个新的人工智能野兽苏醒了!

生成式人工智能的真正赢家!

人工智能危险吗?哪些工作面临风险?

数据科学和人工智能是非常广泛的领域,即使你在这些领域工作,LLM相关的内容可能一开始对你来说也很难理解。因此,事先了解这些术语和概念的含义可以更容易的消化其他与LLM相关的内容。

变压器

Transformer是一种完全基于注意力机制的网络架构,最初在Attention is All You Need论文中提出(https://arxiv.org/pdf/1706.03762.pdf)。

它旨在解决循环神经网络的缺点,即:

- 学习速度慢

- 在长序列的情况下遭受梯度消失或长期依赖性的影响

注意力定义了我们需要关注输入序列的哪个部分,而Transformer包含了一个带有注意力层的编码器-解码器架构。

Transformer能够并行处理输入序列,从而解决了训练速度慢的问题。多亏了注意力层,它们才不会遭受梯度消失的问题。

大型语言模型(LLM)

大型语言模型基本上是一个非常大规模的转换器,GPT代表生成式预训练转换器。

这些模型的大小通常以参数的数量来表示,这些参数的数量在数十亿的水平上。

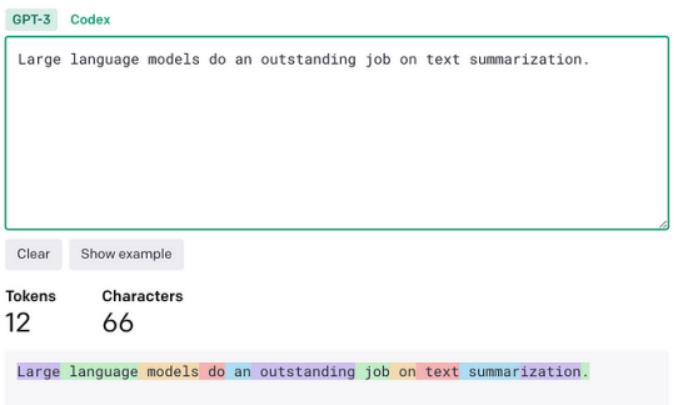

令牌

LLM在进一步处理文本之前将文本转换成小块,这些区块被称为令牌。块通常是单个单词,但这并不总是成立。有时,一个单词可以分成多个块。

下面是一个如何将一段文本拆分为令牌的示例。你可以使用OpenAI的令牌解析器自己尝试一下。

令牌化是使用LLM的一个重要步骤,因为它们有令牌限制。例如,GPT-4的令牌限制为8192个令牌。此限制包括提示和完成。因此,如果你有一个包含8000个令牌的长提示,则最多可以完成192个令牌。

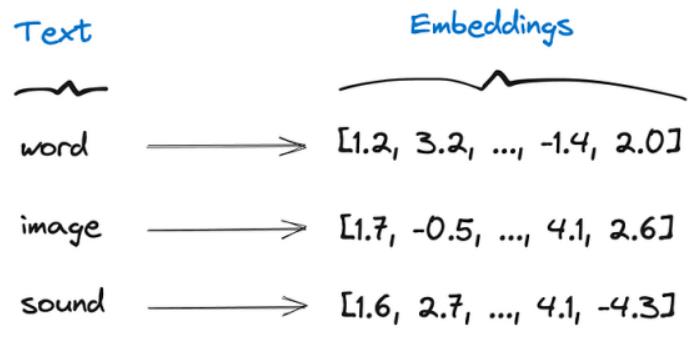

嵌入

嵌入是用于表示文本块的高维向量。

一旦我们将文本转换为向量,我们就可以根据余弦相似度等度量来计算它们的相似程度。数字相似的嵌入在语义上相似,这基本上就是LLM用于生成文本的。

矢量数据库

矢量数据库(或矢量存储)可以被视为一个用于存储向量的数据库。它被优化用于存储大量的向量并能够快速访问它们。

一旦我们对一段文本创建了嵌入向量,最好将它们存储在向量数据库中以便快速查询。

提示

提示符是LLM的输入。它可以像一个简短的问题一样简单,比如“什么是大型语言模型?”或者,你可以创建包含外部文档的很长的提示。

如何编写提示以及在其中包含什么内容对于从LLM获得所需的输出至关重要。它们本质上不是确定性的,所以根据提示,你可能会得到非常不同的结果。

编写提示实际上已经成为提示工程术语下的一种技能。

提示工程中使用了不同的技术,例如少样本提示和思维链提示。

温度

温度是OpenAI的LLM的一个参数。它调整输出的随机性。较高的值(如 0.8)将使输出更加随机,而较低的值(如 0.2)将使其更加集中和确定。

上下文引入或上下文学习

LLM接受过大量数据的培训,因此他们对几乎所有一般主题都有不错的了解。然而,当涉及到特定任务时,LLM可能会表现不佳,因为没有接受过与该特定任务相关的数据训练。

考虑一个案例,你想使用LLM创建一个聊天机器人来回答有关你公司内部文档的问题。由于LLM没有看到任何这些文件,因此该聊天机器人将毫无用处。

用于解决此问题的技术之一是上下文引入。这意味着在提示中添加相关上下文以及我们想要询问的内容。这种附加上下文可以是自由文本的形式,也可以是存储在矢量数据库中的文档。

我们还可以要求LLM仅使用给定的上下文来回答问题,以防止其使用其一般训练数据中的信息。

微调

对LLM微调意味着针对特定任务对其进行优化。它与上下文摄取不同,因为微调它的目标是调整LLM的通信方式。

微调通常是通过向LLM提供所需问答格式的示例来完成的。

LangChain

- LangChain是一个用于使用LLM的应用程序的开源开发框架。

- LangChain提供了几个组件来以更高效和更编程的方式使用LLM。

- 它以组件的形式提供抽象,以便以更高效或编程的方式使用LLM。

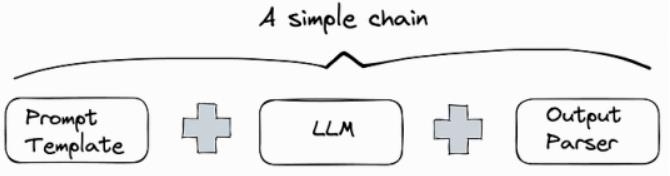

其中一些组件包括:

- 模型:ChatGPT或其他LLM

- 提示:提示模板和输出解析器

- 索引:获取外部数据,如文档加载程序和矢量存储

- 链:组合组件以创建端到端的用例。一个简单链的例子可以是Prompt+LLM+Output Parser

- 代理:使LLM使用外部工具

我们学习了在LLM相关内容中经常遇到的10个术语和概念。如果你知道这些,就会更容易消化这些内容,并帮助你理解更多。

感谢阅读。你还可以订阅我们的YouTube频道,观看大量大数据行业相关公开课:https://www.youtube.com/channel/UCa8NLpvi70mHVsW4J_x9OeQ;在LinkedIn上关注我们,扩展你的人际网络!https://www.linkedin.com/company/dataapplab/

原文作者:Soner Yıldırım

翻译作者:文杰

美工编辑:过儿

校对审稿:Chuang

原文链接:https://sonery.medium.com/10-must-know-terms-and-concepts-to-better-understand-chatgpt-and-llms-f9a6a474f543